統計的声質変換 (7) GMMによる声質変換

統計的声質変換 (6) 声質変換モデルの学習の続き。今回が統計的声質変換シリーズの最終回です。

今回は、前回学習した声質変換モデルを使って本当に声が変換できるか試してみたい。前回やったGMMの学習で

における各コンポーネント の

と

と

が学習データから推定された状態である。

と

は、

のように分割できる。この学習結果は、

clb_slt.gmm clb_slt.gmm_01.npy clb_slt.gmm_02.npy clb_slt.gmm_03.npy

の4つのファイルにダンプされている。

GMMによる声質変換

GMMによる声質変換は、が与えられたときの

の期待値を求めることで行う。

ここで、

である。今回は導出は省いて、論文(PDF)の結果をそのまま借用しよう。

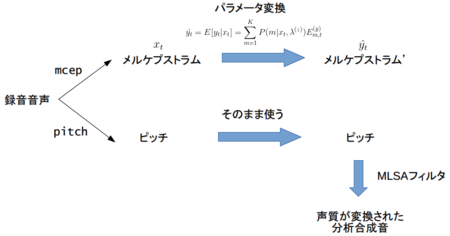

たとえば、Aさんの声をBさんの声に変換することを考える。Aさんの声から抽出したメルケプストラムパラメータ を使って上の式で変換すると

が求められる。この

を使って分析合成すると元のAさんの声がBさんの声になっているというわけ。今回は、ピッチの変換モデルは学習していないので変換元のAさんから抽出したパラメータをそのまま使う。

当たり前であるが変換モデルを学習するときにはAさんとBさんの両方の声が必要だったが、実際に声質を変換するときはAさんの声だけあればよい。上の式で本当にAさんの声がBさんの声になるかさっそく実装して試してみよう。

作成したスクリプト

上の式では、コンポーネントを表す変数に m を使っているが、スクリプトではメルケプストラムの次数に使ってしまったため代わりに K を使っているので注意。

先の式はすべてのフレーム t について計算する必要があるためそのまま実装すると非常に計算が重い。そこで、計算を高速化するためにいくつか工夫している。

- 式 (11) のフレームtに依存しない項(共分散行列の積)を最初に計算して保存しておく

- 式 (9) の分母を先に計算して保存しておき、分子は再計算しない

- 式 (9) の多次元正規分布のオブジェクトをあらかじめ作成しておく

順に確かめたところ3つめが一番高速化に寄与していた。オブジェクト作成というのはけっこう重い処理のようだ。

声質変換例

さっそく上のスクリプトを使って音声を変換してみよう。今回は、clbさんの声をsltさんの声に変換する。aセットの最初の50文はGMMの学習に使用したのでそれ以外の文を使ってテストした。

python convert_voice.py wav/clb/arctic_b0001.wav clb_slt.gmm converted_b0001.wav

変換元(clb)の音声

変換先(slt)の音声

clbからsltへ変換した合成音声

別の例。

変換元(clb)の音声

変換先(slt)の音声

clbからsltへ変換した合成音声

GMMの学習に使用したa0028だと・・・

変換元(clb)の音声

変換先(slt)の音声

clbからsltへ変換した合成音声

今回は、ピッチの変換はしていないのでイントネーションはオリジナルのものがそのまま維持される。本来は声質変換したclbの音はsltと似ていなくてはいけないのだが、元の二人の声が似ていることもあり、本当に正しく変換されているのかよくわからない結果になってしまった・・・音質が悪いこともあるがむしろ似ていないように思える。

音質の改善は元のチュートリアル記事にあるようにWORLDという分析合成システムを使うとよさそう。あと学習データ数を増やしたり、GMMの数を調整したり、別の話者でも試してみるとよいかもしれない。今回の手法はかなり昔の基本技術のようで最新の技術はずっと進んでいるようだ。戸田さんの講演資料が参考になりそう。クッソムズそうだけどね。